Independência computacional para o servidor judiciário

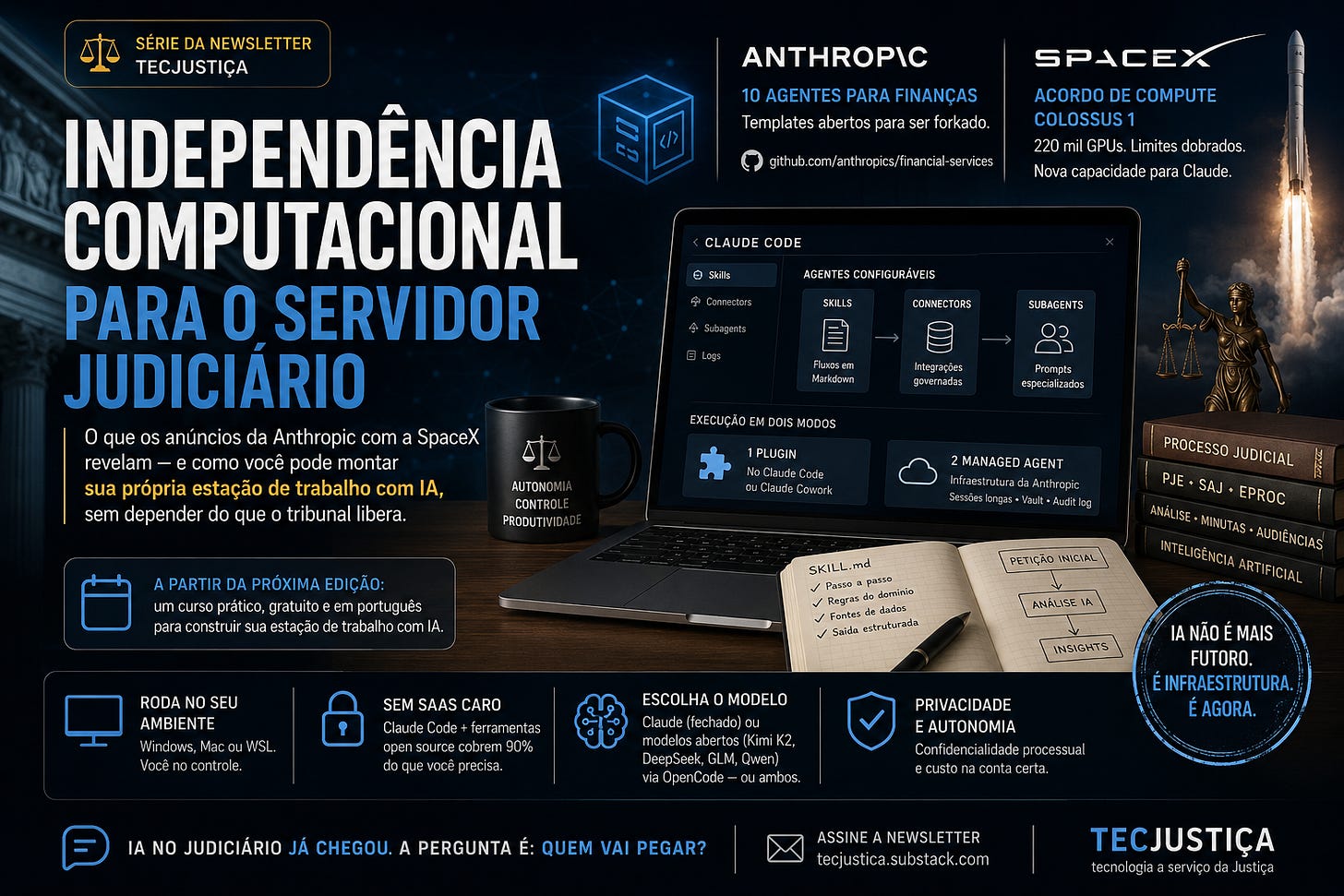

O que os dois anúncios da Anthropic desta semana revelam — e por que as próximas edições da newsletter vão te mostrar como montar a tua própria estação de trabalho com IA

O que os dois anúncios da Anthropic desta semana revelam — e por que as próximas edições da newsletter vão te mostrar como montar a tua própria estação de trabalho com IA, sem depender do que o tribunal libera.

A cena que já é realidade em Wall Street (e que o servidor brasileiro precisa entender)

Imagina que tu, técnico judiciário, abrisse o computador na segunda-feira de manhã e tivesse pronto um agente que prepara tua audiência criminal lendo os autos pelo número CNJ, montando a timeline de prescrição, listando depoimentos a colher e gerando minuta de despacho de saneamento. Sem aguardar o tribunal liberar nada. Sem licitação. Sem comitê de TI.

Em Wall Street, foi exatamente isso que aconteceu nesta semana — só que com pitchbook em vez de despacho, e KYC em vez de qualificação das partes. A Anthropic publicou o repositório anthropics/financial-services com dez templates de agentes prontos para os fluxos mais pesados de bancos, asset managers e seguradoras. Repositório público. Em markdown e YAML. Forkável.

E na noite seguinte fechou um acordo com a SpaceX que dobrou os limites do Claude Code da noite para o dia.

Vistos isolados, esses dois movimentos parecem notícia de tecnologia. Vistos juntos, são um mapa. E quem trabalha com processo judicial precisa lê-lo com atenção, porque o caminho que a Anthropic abriu para Wall Street é exatamente o que serve ao servidor judiciário brasileiro — com uma diferença crítica: nenhum tribunal vai abrir esse caminho para nós. Vamos ter que abrir sozinhos.

É sobre isso que esta newsletter vai tratar nas próximas semanas. Antes de detalhar o roteiro, deixa eu desempacotar o que aconteceu.

O que a Anthropic entregou para Wall Street (e por que é diferente do que parece)

Quando uma das grandes plataformas de IA anuncia “agentes para finanças”, a leitura preguiçosa é: eles vão vender uma plataforma fechada, os bancos vão pagar uma fortuna, e nada disso me afeta.

Não é o que aconteceu.

O repositório anthropics/financial-services é público, em markdown e YAML, e foi publicado para ser forkado. Cada um dos dez agentes é uma reference architecture construída sobre três blocos.

Pensa num agente como um estagiário de elite. A skill é o manual de procedimento que ele segue passo a passo. Os connectors são as credenciais que dão a ele acesso às bases onde os dados moram. Os subagents são os especialistas que ele chama quando o caso foge do escopo dele — análise comparativa, checagem de metodologia, validação de cálculo.

Tecnicamente: skills são arquivos markdown que descrevem o passo a passo do fluxo (o mesmo formato que tu já usa nas tuas skills do Claude Code); connectors são integrações governadas com fontes de dados; subagents são chamadas a Claude com prompts especializados.

E há um detalhe importante: os mesmos templates rodam em dois modos.

Como plugin dentro do Claude Code ou do Claude Cowork — o agente trabalha ao lado do analista, no software que ele já usa.

Como Managed Agent na infraestrutura da Anthropic — execução autônoma, sessões longas, vault de credenciais, audit log no Claude Console.

A leitura correta dessa jogada não é “a Anthropic vai dominar o backoffice de Wall Street”. É outra: a Anthropic decidiu que a interface entre IA e domínio especializado é o agente configurável, não o produto SaaS fechado. Os bancos clonam o repositório, adaptam às próprias políticas de risco e modelos internos, e plugam em Excel, PowerPoint, Word e Outlook via os add-ins do Microsoft 365 que entraram em GA no mesmo dia.

A Anthropic vende o motor. O conhecimento de domínio é do usuário.

Esse é exatamente o argumento que venho fazendo aqui há meses sobre o judiciário brasileiro. E é a razão pela qual o TecJustiça MCP foi construído como ponte — não como produto.

O acordo SpaceX e o que mudou hoje no teu Claude Pro

Aqui a notícia é mais direta, mas não menos importante: a Anthropic fechou acordo para usar toda a capacidade computacional do Colossus 1 em Memphis — o data center que a SpaceX construiu para a xAI antes da fusão (a xAI deixou de existir como empresa separada e virou SpaceXAI).

Os números:

220 mil GPUs NVIDIA, incluindo H100, H200 e GB200.

300+ MW de capacidade nova entrando em operação em até um mês.

Capacidade direcionada principalmente a Claude Pro e Claude Max.

Os efeitos práticos, válidos a partir de ontem:

Os limites de cinco horas do Claude Code dobraram para Pro, Max, Team e Enterprise por assento.

Foi removida a redução de limite em horário de pico para Pro e Max.

Os rate limits da API para Claude Opus aumentaram de forma considerável.

Há também um detalhe geopolítico que vale registrar — e que importa mais para nós do que parece. Em março, o Pentágono classificou a Anthropic como “supply chain risk”, efetivamente vetando contratos federais. Diversificar capacidade de computação para fora da dependência de Amazon e Google deixou de ser opcional para a empresa: virou questão de sobrevivência operacional. O acordo com a SpaceX é parte dessa resposta.

A lição para nós, que dependemos de fornecedores únicos para a nossa própria infraestrutura digital de trabalho, é direta: monocultura tecnológica é fragilidade, não eficiência. Se a Anthropic não pode se dar ao luxo de ter um único fornecedor de GPU, o servidor judiciário não pode se dar ao luxo de ter uma única ferramenta para produzir trabalho intelectual.

A mesma lógica explica o passo seguinte: a Anthropic manifestou interesse em desenvolver, com a SpaceX, data centers orbitais com múltiplos gigawatts. Compute em órbita é planejamento de infraestrutura para a próxima década, não ficção científica. A infraestrutura de IA está se tornando commodity geopolítica, e quem depender de um único fornecedor — externo ou interno — vai ficar refém de decisões que não controla.

O que isso significa para quem trabalha em Vara

Vou ser direto sobre a tese desta newsletter, porque ela ficou mais clara nesta semana.

O servidor judiciário hoje opera dentro de uma armadilha silenciosa. As plataformas que usamos no dia a dia — PJe, SAJ, eproc, ferramentas de gestão administrativa — são caixas-pretas que ditam o ritmo do nosso trabalho. Quando vem “IA”, vem do mesmo lugar: módulos integrados às plataformas oficiais, com timeline de implantação medido em anos, escopo definido por comitês, e zero capacidade de o servidor adaptar a ferramenta ao próprio fluxo.

Enquanto isso, em Wall Street, um analista júnior que clona o repositório anthropics/financial-services na segunda-feira roda um agente de pitchbook na terça. Sem comitê. Sem RFP. Sem migração corporativa.

A diferença não é orçamento. É arquitetura.

E aqui está o ponto que é fácil de perder: a arquitetura que a Anthropic abriu para o setor financeiro é exatamente a mesma que serve ao trabalho judicial. Skills em markdown, conectores governados, subagentes especializados, plugins que rodam dentro do software que já está aberto na tela. Trocar pitch-agent por audiencia-criminal-prep, kyc-screener por triagem-cumprimento-sentenca, gl-reconciler por conciliacao-precatorios é uma adaptação de domínio, não de tecnologia.

O TecJustiça MCP já existe há meses operando essa mesma lógica para o DataLake. As skills do Claude Code para análise processual cível e criminal já estão escritas. O que falta agora é um movimento maior: mostrar que cada profissional judiciário, individualmente, pode montar sua própria estação de trabalho com IA — usando as mesmas ferramentas que JPMorgan e Goldman Sachs estão usando.

Não é exagero. É o jogo que a Anthropic acabou de tornar explícito.

O que vem nas próximas edições

A partir da próxima edição, esta newsletter vira um curso prático — gratuito, em português, voltado para servidores, magistrados, assessores, advogados públicos e qualquer profissional que trabalhe com processo judicial e queira deixar de depender de plataformas externas.

A linha editorial é clara: independência computacional do profissional judiciário. Isso significa três coisas concretas:

Tu não precisa esperar o tribunal liberar IA. A camada que importa para o teu trabalho roda no teu próprio ambiente — Windows, Mac ou WSL.

Tu não precisa pagar SaaS jurídico caro. A combinação de Claude Code, Claude Cowork e ferramentas open source cobre 90% do que esses produtos prometem, com a vantagem de tu ter controle total sobre o fluxo.

Tu pode escolher entre rodar com modelos fechados (Claude) ou com modelos abertos (Kimi K2, DeepSeek, GLM, Qwen) via plataformas como OpenCode — ou os dois ao mesmo tempo. Confidencialidade processual e custo entram na conta de forma diferente quando tu controla a stack.

Para chegar lá, vamos andar passo a passo. Cada edição se constrói sobre a anterior — e isso é por design. O roteiro:

Edição 1 — Mapa do terreno Promessa: tu vai entender, sem código, como Claude Code, Claude Cowork, OpenCode e modelos abertos se encaixam no fluxo do servidor. Entrega: mapa visual + glossário comentado de cada peça.

Edição 2 — Configuração do ambiente Promessa: deixar tua máquina pronta para rodar tudo o que vem depois. Entrega: roteiro de instalação para Windows com WSL2, Mac e Linux, com prints e comandos completos.

Edição 3 — Tua primeira skill Promessa: construir e testar uma skill de análise de petição inicial cível. Entrega: SKILL.md comentado linha a linha + repositório público para clonar.

Edição 4 — Plugando dados reais via MCP Promessa: conectar o teu Claude ao TecJustiça MCP e analisar processo direto pelo número CNJ. Entrega: tutorial de instalação, autenticação e exemplo de análise ponta a ponta.

Edição 5 — Subagentes para tarefas pesadas Promessa: saber quando vale separar um subagent (ex.: análise de prescrição penal) e quando não vale. Entrega: dois subagents prontos, com código, e os critérios de decisão que aprendi na prática.

Edição 6 — OpenCode + Kimi K2 para casos sensíveis Promessa: rodar com modelo aberto quando confidencialidade ou custo pedirem. Entrega: configuração completa, comparação de custo e os trade-offs reais que vi.

Edição 7 — Claude Cowork no fluxo de gabinete Promessa: preparação de audiência, triagem de cumprimento de sentença e revisão em lote de minutas. Entrega: agente personalizado por tipo de Vara, com walkthrough.

Edição 8 — Publicando teu trabalho Promessa: compartilhar tuas skills com colegas de forma estruturada. Entrega: guia de contribuição open source aplicado ao contexto do servidor judiciário.

Cada edição vai ter o material reproduzível em GitHub público, com licença permissiva. Quem quiser adaptar para sua Vara, seu Tribunal ou seu escritório, pode.

Por que faço isso

Há uma janela — e ela está se fechando — em que o profissional judiciário individual ainda pode tomar para si a infraestrutura de IA antes que ela seja domesticada por dentro da estrutura oficial. A Resolução CNJ 332/2020 lançou os princípios de governança de IA no Judiciário. Os tribunais começam agora a estruturar respostas concretas. Mas entre princípio e ferramenta de mesa há licitação, homologação, integração com PJe — um ciclo que conhecemos bem e que se mede em anos, não em meses.

Quem chegar antes nesse intervalo vai operar com vantagem desproporcional. Quem deixar passar vai ficar dentro do que a estrutura oficial liberar — escopo, ritmo e limites incluídos.

A Anthropic acabou de mostrar para Wall Street como funciona o lado certo dessa fronteira: templates abertos, infraestrutura sólida, agente como peça configurável. As ferramentas estão na mesa. O que falta é alguém traduzir isso para a realidade do servidor brasileiro de forma prática, sem academicismo e sem hype.

É o que vou fazer nas próximas semanas. Se isso interessa, assina a newsletter — as edições saem na sequência, uma por semana, e cada uma se constrói sobre a anterior. Quem chegar na edição 5 sem ter feito as 4 primeiras vai ficar perdido. Faz parte.

E se tu já é assinante, manda essa edição para um colega que ainda acha que IA no judiciário só vai chegar quando o CNJ resolver. Ela já chegou. A pergunta é quem vai pegar.

Marcos — TecJustiça tecjustica.substack.com

Fontes desta edição:

Anthropic — Higher usage limits for Claude and a compute deal with SpaceX: anthropic.com/news/higher-limits-spacex

Anthropic — Finance agents announcement: anthropic.com/news/finance-agents

Repositório oficial: github.com/anthropics/financial-services

xAI — New Compute Partnership with Anthropic: x.ai/news/anthropic-compute-partnership